ターミナルから手軽にLLMを呼び出せるツールで、Ollamaをバックエンドとして利用できる有力なツールはいくつか存在します。

2026年現在、特に人気があり、機能性が高いものを用途別に紹介します。

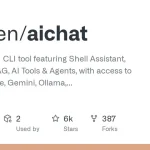

1. aichat (オールラウンダー)

gemini-cliに最も近く、かつ高機能なのが aichat です。Rust製で非常に高速、かつ設定ファイル一つでOllamaを含む多様なバックエンドを切り替えられます。

- 特徴: インタラクティブなチャットモード、標準入力からのパイプ処理、ロール(役割)の切り替えがスムーズ。

- Ollama連携:

config.yamlにollamaのエンドポイント(通常localhost:11434)を記述するだけで使えます。 - 使い方:

# パイプで使う例cat code.py | aichat "このコードをリファクタリングして"

2. mods (Unix哲学派)

Charm が開発している、CLIでの利用に特化したツールです。

- 特徴: 「パイプで渡して結果を整形して出す」というUnix的な使い勝手が抜群に良いです。Markdownのレンダリングも綺麗です。

- Ollama連携: 環境変数や設定でローカルのAPIエンドポイントを指定可能です。

- 使い方:

ls -l | mods "このファイル一覧の概要をまとめて"

3. llm (拡張性重視)

Simon Willison氏によるPython製のツールで、プラグインシステムが非常に強力です。

- 特徴: 履歴をSQLiteに保存でき、後から過去のチャットを検索しやすいのが強みです。

- Ollama連携:

llm-ollamaプラグインをインストールすることで連携します。 - セットアップ:

pip install llmllm install llm-ollama# Ollamaのモデルを登録して実行llm -m ollama/llama3.3 "こんにちは"

4. ShellGPT (sgpt) (シェル操作特化)

元々はOpenAI向けでしたが、2026年現在はLiteLLM等を経由してOllamaをネイティブに近い形でサポートしています。

- 特徴: シェルコマンドの生成(

--shell)に強く、「〇〇するコマンドを書いて」と頼んでそのまま実行させるような用途に最適です。 - 使い方:

sgpt --shell "カレントディレクトリのログファイルからエラーを抽出して"

比較表

| ツール名 | 推奨用途 | 言語 | 特徴 |

| aichat | 汎用・開発 | Rust | 高速・多機能。設定が簡単。 |

| mods | パイプ・自動化 | Go | デザインが洗練。スクリプトに組み込みやすい。 |

| llm | 履歴管理・RAG | Python | プラグインが豊富。過去のログ活用に強い。 |

| sgpt | シェル操作補助 | Python | コマンド生成と実行に特化。 |

導入のアドバイス

- シンプルさを求めるなら aichat が一番馴染みやすいはずです。

- ターミナルの「道具」として、他のコマンドと組み合わせて自動化したいなら mods をお勧めします。

コメント